Felix Braun

Felix Braun

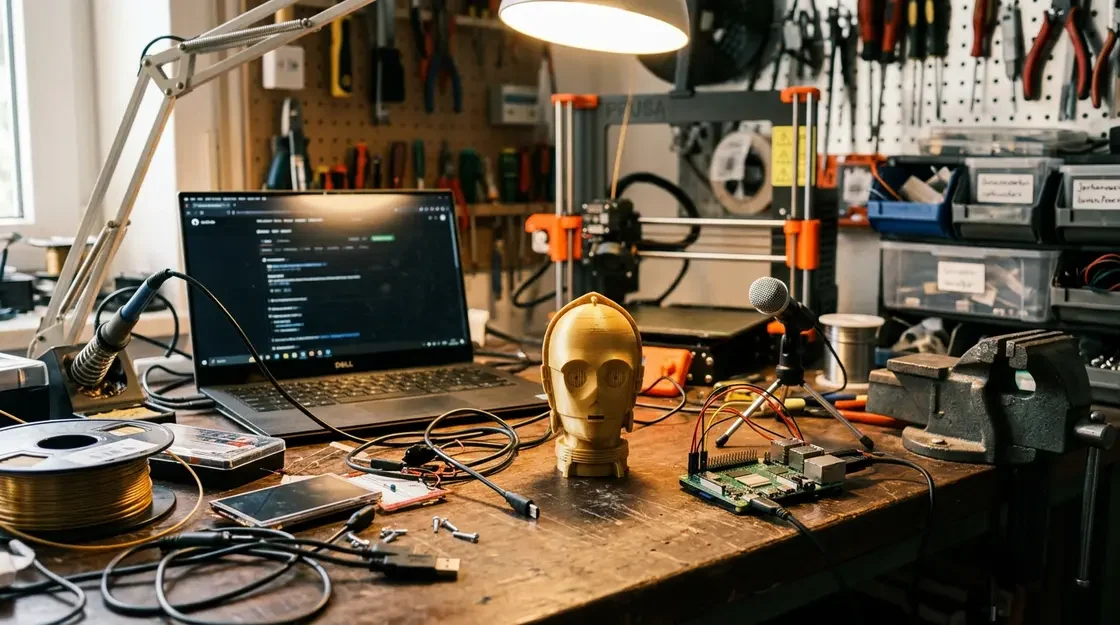

Ich erinnere mich noch gut daran, wie mein erster Heimassistent-Versuch glorreich gescheitert ist: Alexa verstand mich nicht, Google Home schickte meine Fragen in Rechenzentren irgendwo in Übersee, und der Raspberry Pi auf meiner Werkbank schaute mich stumm an wie ein vergessenes Bastelprojekt. Dass ein Forscher jetzt einen C-3PO-Kopf aus dem 3D-Drucker mit echter KI auf genau so einem Pi zum Reden bringt, macht mich ehrlich gesagt neidisch – und zeigt, wohin die Reise bei lokalen Assistenten geht.

Samuel Potozkin, Forscher an der Chapman University in Kalifornien, hat Anfang 2026 etwas gebaut, das das Herz jedes Tech-Nerds höher schlagen lässt. Interesting Engineering berichtete im April 2026 ausführlich darüber: ein lebensgroßer C-3PO-Kopf, komplett aus dem 3D-Drucker, mit echter Sprachinteraktion auf Raspberry-Pi-Basis. Kein Witz. Der Kopf hört zu, denkt nach und antwortet im unverkennbaren Ton des galaktischen Protokolldroids – und das alles ohne einen einzigen Cloud-Server zwingend anzusprechen.

Nerd-Alarm: Potozkin hat dafür einen Prusa Core One als Drucker verwendet, Filament für Schicht um Schicht aufgetragen, dann stundenlang geschliffen und poliert. Die eigentliche Magie steckt aber im Inneren. Ein Raspberry Pi 5 als lokale KI-Plattform übernimmt die komplette KI-Pipeline: Mikrofoneingabe, Transkription per Whisper, Antwortgenerierung durch ein Large Language Model mit C-3PO-Persönlichkeit und schließlich Sprachausgabe. Ein sogenannter Exciter – ein Vibrationswandler direkt auf dem Gehäuse – sorgt für den blechernen Roboterklang. Im Ernst: Dieser Effekt ist eigentlich das Cleverste am ganzen Aufbau.

Spoiler: Alles, von den STL-Dateien bis zum kompletten Code, liegt frei auf GitHub (Repo: samuelpotozkin/c3po-head). Stand Ende April 2026 hatte das Repository bereits über 500 Stars. Das ist kein reines Spielzeug-Projekt – das ist eine funktionale Blaupause.

Der Raspberry Pi 5 ist die Schaltzentrale dieses Bastelprojekts. Mit seinem Quad-Core ARM Cortex-A76 und bis zu 2,4 GHz Taktfrequenz schafft er, was vor zwei Jahren noch undenkbar gewesen wäre: lokale Sprachverarbeitung in Echtzeit. Die Whisper-Bibliothek von OpenAI läuft lokal auf dem Pi und wandelt gesprochene Sprache in Text um. Ein quantisiertes Large Language Model übernimmt die Antwortgenerierung im C-3PO-Stil, bevor Text-to-Speech die Ausgabe wieder in Sprache verwandelt.

Ein wichtiger Hinweis für alle, die „vollständig offline“ lesen und gleich das Projekt nachbauen wollen: Die Sprachausgabe nutzt im Standardsetup ElevenLabs – einen Cloud-Dienst. Wer komplett lokal bleiben will, kann auf Alternativen wie Piper TTS zurückgreifen, die direkt auf dem Pi laufen. Das ist technisch möglich, aber nicht die Out-of-the-Box-Konfiguration des Projekts. Raspberry Pi KI in dieser Form ist also „überwiegend lokal“, nicht automatisch „vollständig cloud-frei“.

Die Latenz variiert je nach Modellgröße. Nutzerberichte aus Maker-Foren sprechen von Reaktionszeiten zwischen einer und fünf Sekunden – das hängt stark davon ab, welches quantisierte Modell verwendet wird und wie viel RAM zur Verfügung steht. Wer mit 8 GB RAM-Variante und kompakten Modellen wie Llama in einer schlanken Quantisierungsstufe arbeitet, kommt nach Anwendererfahrungen auf deutlich unter drei Sekunden. Offizielle Benchmark-Zahlen gibt es dazu noch nicht.

Ein sprechender Roboterkopf aus einer Science-Fiction-Saga klingt zunächst nach reiner Spielerei. Aber das Projekt zeigt exemplarisch, wohin sich Smart-Home-Assistenten entwickeln könnten. Die zentrale Frage lautet: Muss ein intelligenter Heimassistent überhaupt in die Cloud?

Im Ernst: Wer heute einen klassischen Sprachassistenten von Amazon oder Google nutzt, schickt jede Anfrage auf Reisen durch fremde Rechenzentren. Das ist praktisch, aber datenschutztechnisch eine Baustelle. Besonders unter der europäischen DSGVO ist das eine echte Grauzone, die viele Nutzerinnen und Nutzer gar nicht vollständig durchdenken. Ein lokaler Assistent auf Raspberry-Pi-Basis speichert nichts extern, sendet keine Anfragen in unbekannte Infrastruktur und ist vollständig kontrollierbar.

Der Markt bewegt sich spürbar in diese Richtung. Popular Science beschreibt das C-3PO-Projekt als Beleg dafür, dass lokale KI auf Heimhardware angekommen ist. Raspberry-Pi-Verkäufe stiegen laut Angaben der Raspberry Pi Foundation im Jahr 2025 auf etwa sieben Millionen Einheiten, mit steigendem Anteil an KI-Anwendungen. Projekte mit lokalen Sprachmodellen auf Single-Board-Computern sind dabei ein erkennbarer Wachstumstreiber.

Was spricht für lokale Assistenten auf Raspberry Pi? Erstens: Datenschutz. Alles bleibt im eigenen Netzwerk. Kein Drittanbieter wertet Anfragen aus, kein Abo läuft still im Hintergrund weiter. Zweitens: Unabhängigkeit. Kein Internet? Kein Problem – zumindest für die Kernfunktionen. Smart Home lässt sich so auch bei Netzwerkausfall weiterbetreiben.

Drittens, und das ist oft unterschätzt: Personalisierbarkeit. Der C-3PO-Kopf zeigt das perfekt. Das LLM bekommt eine Persönlichkeit eingepflanzt – in diesem Fall den Protokolldroiden aus Star Wars. Das gleiche Prinzip lässt sich auf Heimassistenten übertragen. Ein Assistent, der genau die Befehle versteht, die im eigenen Haushalt genutzt werden, der spezifische Automatisierungen kennt und keine unnötigen Allgemein-Features mitschleppt: Das ist mit lokal laufenden Modellen realistisch umsetzbar.

Wer jetzt denkt, der Raspberry Pi ersetzt morgen Google Home komplett, sollte kurz innehalten. Lokale Assistenten haben klare Schwächen. Die Hardwarekosten für einen vollständigen Nachbau des C-3PO-Projekts liegen laut Schätzungen aus Maker-Foren bei rund 200 bis 300 Euro – Pi 5 etwa 80 Euro, Filament und Druckzeit zusätzlich, Exciter und Peripherie obendrauf. Das ist kein Impulskauf.

Außerdem braucht das Setup technisches Grundwissen. Docker, GitHub, Modell-Download, Konfiguration – das ist kein Plug-and-Play wie ein kommerzieller Smart-Home-Hub. Wer nicht bereit ist, Stunden mit Debugging zu verbringen, wird frustriert aufgeben. Das Bastelprojekt richtet sich an Menschen, die Spaß am Tüfteln haben, nicht an den klassischen Consumer-Markt.

Und dann ist da noch die Rechenleistung. Komplexe Anfragen, schnelle Antworten bei gleichzeitiger Steuerung mehrerer Smart-Home-Geräte – der Pi 5 ist beeindruckend, aber kein Wunderwerk. Wer einen vollwertigen Smart-Home-Server betreiben will, sollte über leistungsstärkere Mini-PCs oder dedizierte Hardware nachdenken.

Wer lokal und smart denkt, kommt an Home Assistant nicht vorbei. Die Open-Source-Plattform läuft seit Jahren auf Raspberry Pi – von einfachen Pi 3-Setups bis zum aktuellen Pi 5. Home Assistant verbindet Geräte unterschiedlichster Hersteller, von IKEA über Bosch bis zu Matter-kompatiblen Produkten, und lässt alles lokal kommunizieren.

Das C-3PO-Bastelprojekt und Home Assistant verfolgen dieselbe Grundidee: lokale Kontrolle statt Cloud-Abhängigkeit. Wer Home Assistant bereits nutzt, könnte die Sprachinteraktions-Pipeline aus dem C-3PO-Projekt theoretisch adaptieren und als lokale Sprachsteuerung einbinden. Das ist kein einfaches Wochenendprojekt, aber technisch machbar. Whisper für Transkription, ein lokales LLM für Befehlsinterpretation, die Home-Assistant-API für Geräteansteuerung – die Bausteine sind vorhanden.

Raspberry Pi KI in Verbindung mit Home Assistant wäre dann ein echter lokaler Assistent: hört zu, versteht natürliche Sprache, steuert das Zuhause – ohne dass eine Anfrage das Heimnetz verlässt. Das ist heute noch ein ambitioniertes Bastelprojekt, aber die Richtung ist klar.

Es wäre unehrlich, das Bild zu zeichnen, als ob lokale Raspberry-Pi-Assistenten in absehbarer Zeit die etablierten Cloud-Lösungen vollständig ablösen. Dafür gibt es handfeste Gründe, die auch überzeugte Datenschutzfreunde ernst nehmen sollten.

Cloud-Dienste wie Alexa oder Google Assistant profitieren von enormen Rechenressourcen, die kontinuierlich mit neuen Daten trainiert werden. Die Spracherkennungsqualität bei Dialekten, Akzenten oder undeutlicher Aussprache ist dort nach wie vor besser als bei lokal betriebenen Whisper-Instanzen auf kompakter Hardware. Wer in einem Mehrpersonenhaushalt lebt und verschiedene Stimmen und Sprechweisen unter einen Hut bringen muss, wird das im direkten Vergleich merken.

Auch der Funktionsumfang unterscheidet sich erheblich. Musikstreaming-Integration, Einkaufslisten, die mit dem Smartphone synchronisieren, oder Live-Informationen aus dem Netz – das alles lässt sich lokal nur mit erheblichem Mehraufwand oder gar nicht reproduzieren. Für viele Haushalte ist die Convenience der Cloud-Lösung schlicht ein stärkeres Argument als der Datenschutzvorteil einer lokalen Alternative.

Das bedeutet nicht, dass lokale Assistenten keine Zukunft haben. Aber der realistische Anwendungsfall ist derzeit eher der technisch versierte Haushalt, der bewusst auf bestimmte Features verzichtet, um dafür volle Kontrolle zu gewinnen. Für die breite Masse bleibt die Cloud noch auf absehbare Zeit das kleinere Übel – oder eben die einfachere Wahl.

Wer sich von der Theorie zur Praxis vorarbeiten möchte, findet in den folgenden Szenarien eine grobe Orientierung. Sie sind bewusst vorsichtig formuliert, weil sich Setups je nach Softwareversionen und individuellem Netzwerk unterscheiden können.

Einen Raspberry Pi 5 mit 8 GB RAM aufsetzen, das GitHub-Repository des C-3PO-Projekts klonen und die Docker-Compose-Konfiguration starten. Ziel ist nicht ein fertiger Assistent, sondern das Verständnis der Pipeline: Wie fließt Sprache vom Mikrofon durch Whisper ins Sprachmodell und zurück zur Ausgabe? Wer diesen Kreislauf einmal selbst debuggt hat, versteht lokale KI-Architekturen auf eine Art, die keine Dokumentation ersetzen kann. Zeitaufwand: realistisch ein bis zwei Wochenenden.

Wer Home Assistant bereits betreibt, kann Whisper als Add-on über den Home-Assistant-Supervisor installieren – das ist offiziell unterstützt und deutlich einfacher als eine manuelle Einrichtung. In Kombination mit dem ebenfalls verfügbaren Piper-TTS-Add-on entsteht so eine vollständig lokale Sprachsteuerung, die ohne Cloud auskommt. Die Qualität ist solide für einfache Befehle wie Licht an, Thermostat runter oder Rollläden schließen. Komplexere Konversation ist hier nicht das Ziel – aber für Heimautomatisierung braucht man das auch nicht.

Wer weder auf Cloud-Komfort noch auf Datenschutz vollständig verzichten möchte, kann einen Hybrid-Ansatz wählen: Die Heimsteuerung läuft lokal über Home Assistant auf dem Pi, während für allgemeine Fragen oder Informationsanfragen optional ein Cloud-Dienst eingebunden bleibt – aber nur auf ausdrücklichen Benutzerbefehl. So bleibt die Kontrolle über sensible Heimdaten lokal, während die Flexibilität erhalten bleibt. Das ist kein perfekter Datenschutz, aber ein pragmatischer Kompromiss für den Alltag.

Samuel Potozkins Arbeit ist mehr als ein Fan-Projekt. Es ist ein Proof of Concept, der zeigt: Die Bausteine für einen ernsthaften lokalen KI-Assistenten sind verfügbar, erschwinglich und offen dokumentiert. Adafruit hat das Projekt mit direktem GitHub-Link aufgenommen – ein Zeichen, dass die Maker-Community das Potenzial erkannt hat.

Drei Erkenntnisse bleiben hängen. Erstens: Raspberry Pi KI ist kein Zukunftsversprechen mehr. Whisper-Transkription, quantisierte LLMs, lokale TTS – das läuft heute auf Consumer-Hardware. Zweitens: Open Source ist der Schlüssel. Ohne GitHub, ohne frei zugängliche Modelle und Bibliotheken wäre dieses Projekt nicht in Monaten, sondern in Jahren umzusetzen gewesen. Drittens: Die Persönlichkeit macht den Unterschied. Ein Assistent, der sich anfühlt wie ein Charakter und nicht wie eine Datenbank, wird tatsächlich genutzt.

Meine persönliche Einschätzung: Was hier passiert, ist ein Vorbote. In zwei, drei Jahren werden lokale Smart-Home-Assistenten auf Raspberry-Pi-Basis oder vergleichbarer Hardware für technisch versierte Haushalte keine Nischenlösung mehr sein. Die Community baut gerade die Grundlagen dafür – und ein sprechender Droidenkopf aus dem 3D-Drucker ist das charismatischste Beispiel dafür, das ich seit Langem gesehen habe.

Wer jetzt nicht in monatelange 3D-Druck-Arbeit einsteigen will, aber trotzdem mit lokalem Raspberry Pi KI experimentieren möchte: Das GitHub-Repository des Projekts ist der einfachste Einstiegspunkt. Die Dokumentation beschreibt Installation und Konfiguration, inklusive Docker-Compose-Setup für Whisper und das LLM.

Als Hardware-Basis empfiehlt sich der Raspberry Pi 5 mit 8 GB RAM – das gibt genug Spielraum für kompakte, quantisierte Sprachmodelle. Wer Home Assistant bereits betreibt, kann parallel experimentieren, ohne das bestehende Smart-Home-Setup zu gefährden. Ein separater Pi als Testgerät kostet überschaubar und hält die Produktivumgebung sauber.

Für den ersten Schritt lohnt sich auch ein Blick auf Piper TTS als vollständig lokale Sprachausgabe-Alternative zu ElevenLabs. Weniger dramatisch im Klang, aber komplett offline und ohne Datenweitergabe. Wer dann noch einen Exciter an sein Gehäuse schraubt, ist dem Roboterstimmentraum schon ein Stück näher.

Ein sprechender C-3PO-Kopf auf dem Schreibtisch ist vielleicht nicht das Smart-Home-Gerät, das irgendjemand bei der Küchenplanung eingeplant hat. Aber als Demonstrationsobjekt für das Potenzial von Raspberry Pi KI und lokalen Assistenten ist es kaum zu schlagen. Die Bausteine sind da. Die Community baut. Und die Frage, die mich ehrlich umtreibt: Wann baut jemand daraus das erste wirklich brauchbare, vollständig lokale Smart-Home-Sprachinterface – ohne Droiden-Kostüm, aber mit demselben technischen Fundament?

Haben Sie schon eigene Erfahrungen mit lokalen KI-Projekten auf Raspberry Pi gesammelt? Schreiben Sie es in die Kommentare – ich bin gespannt, was in den Werkstätten und Kellern da draußen gerade entsteht.

Um Ihnen ein optimales Erlebnis zu bieten, verwenden wir Technologien wie Cookies, um Geräteinformationen zu speichern und/oder darauf zuzugreifen. Wenn Sie diesen Technologien zustimmen, können wir Daten wie Ihr Surfverhalten oder eindeutige IDs auf dieser Website verarbeiten. Wenn Sie Ihre Zustimmung nicht erteilen oder widerrufen, können bestimmte Merkmale und Funktionen beeinträchtigt werden.