Lisa Hartmann

Lisa Hartmann

Quantencomputer können bestimmte Probleme elegant knacken, die klassische Rechner in die Knie zwingen. Umgekehrt sind klassische Computer bei vielen Alltagsaufgaben bis heute unschlagbar. Was also, wenn man beide kombiniert? Genau das wollen Forschende der Universität des Saarlandes gemeinsam mit BMW, Infineon und dem Münchner Start-up planqc herausfinden – und das Bundesministerium für Forschung, Technologie und Raumfahrt finanziert dieses Experiment mit 2,33 Millionen Euro.

Hand aufs Herz: Wer beim Begriff „Quantencomputer“ sofort an die Ablösung des klassischen PCs denkt, liegt falsch. Quantencomputer sind keine Allzweckwaffen. Sie glänzen bei hochkomplexen Optimierungsaufgaben und Simulationen, scheitern aber noch an vielem, womit ein gewöhnlicher Laptop täglich umgeht. Der entscheidende Ansatz lautet deshalb nicht „entweder oder“, sondern „sowohl als auch“.

Genau hier setzt das Forschungsprojekt QIAPO an – ausgeschrieben: „Quanteninformierte approximative Optimierung auf NISQ und partiell fehlertoleranten Quantencomputern“. Hinter dem sperrigen Namen steckt eine konkrete Idee: Ein Quantencomputer übernimmt den schwierigsten Teil einer Rechenaufgabe, verkleinert das Problem gewissermaßen, und übergibt es dann an einen klassischen Rechner, der mit seinen bewährten Algorithmen weitermacht.

„Das funktioniert erstaunlich gut. Oft sind Algorithmen, die in der Theorie langsamer sind als andere, in der Praxis dennoch schneller“, erläutert Prof. Dr. Peter P. Orth, Professor für Theoretische Physik der Quanteninformation an der Universität des Saarlandes. Seine Erkenntnis: Selbst bei all ihrer Qualität sind klassische Algorithmen häufig nur die bestmögliche Annäherung – und Quantencomputer könnten genau dort „in die Lücke stoßen“.

Das bekannteste mathematische Rätsel dieser Art ist das „Problem des Handlungsreisenden“: Wie berechnet man die kürzeste Route zwischen vielen Stationen, wenn die Zahl der Zwischenstopps exponentiell wächst? Was wie ein akademisches Gedankenspiel klingt, ist in der Industrie bittere Realität.

Bei BMW geht es um die Optimierung von Fertigungsabläufen und Lieferketten – Millionen von Bauteilen, die täglich koordiniert werden müssen. Bei Infineon, dem Halbleiterhersteller, sind es die komplexen Produktions- und Vertriebsprozesse für Computerchips. Diese Aufgaben sind so umfangreich, dass klassische Algorithmen sie heute nur näherungsweise lösen können.

Das Ziel von QIAPO ist bescheiden, aber realistisch: Wenn sich die Lösungsqualität von derzeit 80 Prozent auf 85 oder gar 95 Prozent steigern lässt, entstehen bei den Produktionsvolumina dieser Konzerne erhebliche Einsparungen. „Bereits geringe Ressourceneinsparungen können bei hohen Produktionsvolumina erhebliche finanzielle Effekte erzielen“, heißt es in der Projektbeschreibung.

Zum Verständnis der mathematischen Tiefe solcher Probleme: Kombinatorische Optimierungsaufgaben gehören zur Klasse der sogenannten NP-schweren Probleme – also jener Aufgaben, für die es keinen effizienten Algorithmus gibt, der garantiert die exakte Lösung findet. Prof. Dr. Peter P. Orth und sein Team an der Universität des Saarlandes forschen genau an der Schnittstelle, wo Quantenalgorithmen diesen blinden Fleck klassischer Computer verkleinern könnten.

Wer sich fragt, wie sich Quantencomputer langfristig auch für breitere Anwendungsfelder entwickeln, bekommt im Kontext solcher Industrieprojekte ein greifbares Bild davon, in welche Richtung die Technologie wächst.

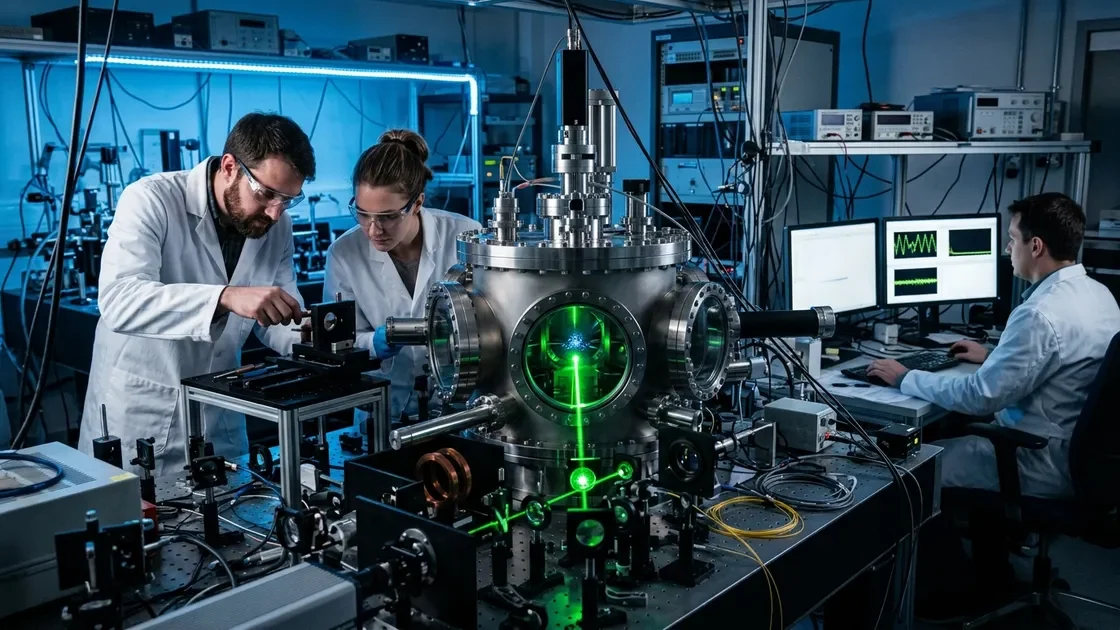

Der Hardware-Partner im Projekt ist planqc, ein Spin-off des Max-Planck-Instituts für Quantenoptik. Das Start-up, 2022 in Garching gegründet, entwickelt Quantencomputer auf Basis neutraler Atome – einem Ansatz, der sich von den bekanntesten kommerziellen Systemen wie denen von IBM oder Google deutlich unterscheidet. Während diese auf supraleitenden Qubits setzen, nutzt planqc einzelne Atome als Quantenbits, die mit Lasern präzise kontrolliert werden.

Der Vorteil: Neutrale Atome gelten als besonders skalierbar, weil sich viele gleichartige Qubits vergleichsweise zuverlässig erzeugen und kontrollieren lassen. „Wir demonstrieren damit bereits heute, wie sich hochkomplexe, industrierelevante Herausforderungen in Quantenalgorithmen übersetzen lassen – die schließlich auf Quantencomputern getestet werden können“, sagt Dr. Martin Kiffner, Head of Algorithms bei planqc.

Das ist kein Selbstlob ins Blaue: planqc ist Teil der Munich Quantum Valley-Initiative, die Bayern zu einem der führenden Standorte für Quantentechnologie machen soll. Mit BMW und Infineon als Industriepartner geht das Projekt direkt in die Anwendung.

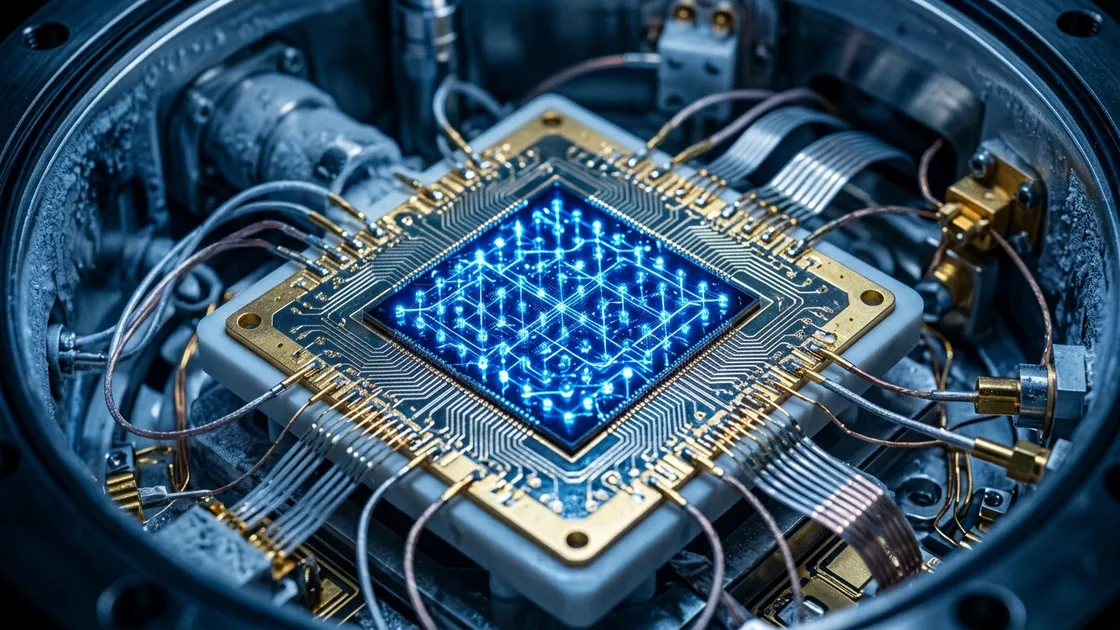

Das technische Prinzip hinter QIAPO ist elegant. Klassische Computer arbeiten mit Bits – entweder 0 oder 1. Quantencomputer nutzen Qubits, die sich in einer Überlagerung beider Zustände befinden können (Superposition). Das erlaubt es ihnen, viele Lösungsansätze gleichzeitig zu erkunden, statt sie der Reihe nach abzuarbeiten.

Der Trick bei QIAPO: Der Quantencomputer übernimmt nicht die gesamte Rechenlast, sondern bereitet ein riesiges Optimierungsproblem so vor, dass ein klassischer Rechner es deutlich effizienter weiterbearbeiten kann. Man stelle es sich vor wie einen Assistenten, der einen unstrukturierten Datenberg sortiert und die relevantesten Cluster herausfiltert – damit der eigentliche Analyst nicht Millionen von Datenpunkten einzeln prüfen muss.

Das Projekt läuft bis Ende 2028 und wird zeigen, ob dieser Ansatz bei realen Industrieproblemen tatsächlich eine messbare Verbesserung bringt. Prof. Orth gibt sich dabei bewusst nüchtern: „Wir werden nun in den kommenden drei Jahren nicht auf Anhieb die großen Probleme lösen. Aber wir werden am Ende mit hoher Wahrscheinlichkeit wissen, ob wir mit unserem Ansatz solche Probleme grundsätzlich lösen können.“

Das ist ehrlicher als viele Quantencomputer-Ankündigungen, die in der Vergangenheit zu viel versprochen haben. Wer die Sicherheitsimplikationen dieser Technologie verstehen möchte, sollte auch einen Blick auf die Entwicklungen in der Quantenkryptographie werfen – denn leistungsfähigere Quantencomputer verändern auch die Spielregeln der Verschlüsselung.

Ein Wort im Projekttitel verdient besondere Aufmerksamkeit: „approximativ“. Das bedeutet, dass QIAPO keine hundertprozentig optimalen Lösungen anstrebt – sondern deutlich bessere Annäherungen als heute möglich. Das klingt nach einem Kompromiss, ist aber in der Praxis entscheidend.

Stellen Sie sich eine Produktionslinie vor, bei der täglich tausende Planungsentscheidungen getroffen werden müssen: Welche Maschine fertigt welches Bauteil in welcher Reihenfolge? Klassische Algorithmen erreichen hier heute vielleicht 80 Prozent der theoretisch optimalen Lösung. Gelingt es, das auf 90 oder 95 Prozent zu steigern, bedeutet das bei einem Automobilhersteller wie BMW reale Millioneneinsparungen – pro Jahr, systematisch.

Das ist der Kern der „quanteninformierten Optimierung“: nicht vollständige Perfektion, sondern ein messbarer Fortschritt gegenüber dem Status quo. Und das bei Aufgaben, bei denen jede Prozentverbesserung wirtschaftlich spürbar ist. Prof. Bläser, Informatik-Experte für Komplexitätstheorie an der Universität des Saarlandes, bringt die algorithmische Expertise mit, um zu verstehen, bei welchen Problemklassen dieser Quantenvorteil überhaupt realistisch zu erwarten ist – und bei welchen klassische Methoden weiterhin unschlagbar bleiben.

Das Akronym NISQ taucht in der Quantencomputing-Welt immer häufiger auf – es steht für „Noisy Intermediate-Scale Quantum“, also Quantencomputer mit einer mittleren Anzahl von Qubits, die noch fehleranfällig sind. Das ist der aktuelle Stand der Technik: Systeme wie die von IBM, Google oder eben planqc haben bereits beeindruckende Fähigkeiten, aber eben noch kein fehlerfreies Rechnen.

Fehlertolerante Quantencomputer – das langfristige Ziel – würden mit sogenannten logischen Qubits arbeiten, bei denen Fehler durch redundante physikalische Qubits korrigiert werden. Dafür bräuchte man nach heutigem Stand tausende oder Millionen physikalischer Qubits pro logischem Qubit. Das ist noch weit entfernt. QIAPO arbeitet deshalb bewusst mit dem, was heute verfügbar ist – NISQ-Systemen mit Neutralatom-Technologie – und fragt, was sich damit schon jetzt sinnvoll erreichen lässt.

Dieser realistische Ansatz ist in der Quantencomputing-Szene keine Selbstverständlichkeit. Zu viele Ankündigungen der letzten Jahre haben suggeriert, dass die quantencomputer-Revolution unmittelbar bevorsteht. Die nüchterne Einschätzung von Prof. Orth – „wir werden wissen, ob es grundsätzlich funktioniert“ – ist ehrlicher als mancher Hype.

Wenige Start-ups in Europa haben in so kurzer Zeit so viel Aufmerksamkeit auf sich gezogen wie planqc. Gegründet im April 2022 von Alexander Glätzle, Sebastian Blatt und Johannes Zeiher als erstes Spin-off des Max-Planck-Instituts für Quantenoptik, positioniert sich das Unternehmen als alternativer Weg zu den dominierenden supraleitenden Systemen.

Der Ansatz mit neutralen Atomen hat einen entscheidenden praktischen Vorteil: Die Qubits sind identisch und stabil, weil es sich um einzelne Atome derselben Sorte handelt. Das macht das System skalierbarer als manche Konkurrenzarchitektur, bei der jedes Qubit leicht unterschiedlich produziert wird und damit eigene Fehlercharakteristiken mitbringt. planqc gilt als einer der aussichtsreichsten europäischen Quantencomputer-Hersteller und ist Teil der Munich Quantum Valley-Initiative, die Bayern als führenden Quantentechnologie-Standort etablieren soll.

Für QIAPO bringt planqc nicht nur Hardware mit, sondern auch algorithmisches Know-how. Head of Algorithms Dr. Martin Kiffner arbeitet daran, reale Industrieprobleme so in Quantenalgorithmen zu übersetzen, dass sie auf dem planqc-System lauffähig werden. Das ist alles andere als trivial – die Brücke zwischen mathematischer Problemformulierung und konkreter Quantenimplementierung ist eine der größten offenen Herausforderungen im Feld.

2,33 Millionen Euro vom Bundesministerium für Forschung, Technologie und Raumfahrt – das ist kein Kleingeld, aber auch kein Mondprogramm. Was dieses Projekt interessant macht, ist weniger die Fördersumme als die Konstellation: Eine Universität, ein Deep-Tech-Start-up und zwei DAX-Konzerne arbeiten gemeinsam daran, Quantencomputing industrietauglich zu machen.

Das unterscheidet sich von den oft zitierten US-amerikanischen oder chinesischen Großprojekten, bei denen Tech-Giganten mit schier unbegrenzten Budgets voranpreschen. Der europäische Ansatz setzt auf enge Kooperation zwischen Wissenschaft und Industrie – und hat dabei durchaus Stärken. Grundlagenforschung, die direkt an realen Unternehmensanforderungen ausgerichtet ist, hat bessere Chancen, tatsächlich anwendbare Ergebnisse zu liefern.

Für Unternehmen, die heute schon mit Optimierungsproblemen kämpfen, ist das eine relevante Nachricht: Hybrid-Quantencomputing könnte in drei bis fünf Jahren bei bestimmten Aufgabenklassen echte Vorteile bringen. Wer sich in diesem Umfeld vorbereiten möchte, sollte die Entwicklungen rund um Quantencomputing in der Unternehmensstrategie im Blick behalten – denn der Einstieg in das Thema lohnt sich früher, als viele denken.

Ob QIAPO letztlich beweist, dass Hybrid-Quantencomputing der nächste große Sprung in der industriellen Optimierung ist – das wird sich bis 2028 zeigen. Wir bei digital-magazin.de werden die Ergebnisse verfolgen. Bis dahin gilt: Das Versprechen ist konkret, die Erwartungen sind realistisch kalibriert, die Partner sind seriös und die Förderung durch den Staat ein klares Signal, dass Deutschland dieses Feld nicht dem Silicon Valley überlassen will. Das ist mehr als bei vielen anderen Quantencomputer-Ankündigungen der vergangenen Jahre – und ein guter Grund, das Projekt im Auge zu behalten.

Um Ihnen ein optimales Erlebnis zu bieten, verwenden wir Technologien wie Cookies, um Geräteinformationen zu speichern und/oder darauf zuzugreifen. Wenn Sie diesen Technologien zustimmen, können wir Daten wie Ihr Surfverhalten oder eindeutige IDs auf dieser Website verarbeiten. Wenn Sie Ihre Zustimmung nicht erteilen oder widerrufen, können bestimmte Merkmale und Funktionen beeinträchtigt werden.