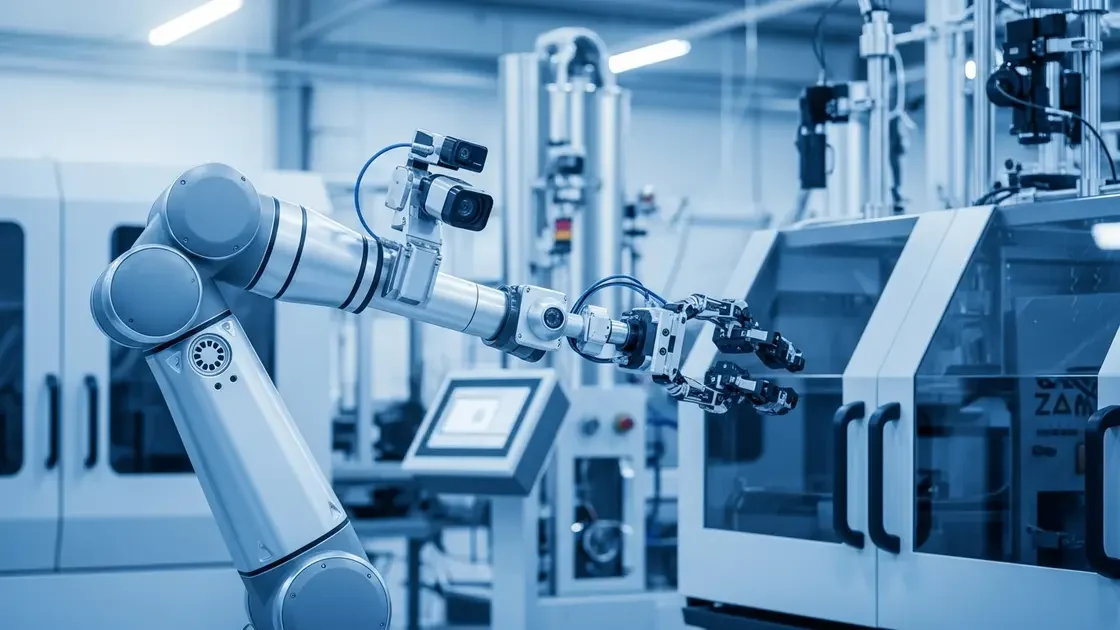

Ein Roboterarm greift nach einem Werkstück – nicht weil er so programmiert wurde, sondern weil er gelernt hat, was zu tun ist. Kein Code, kein festes Skript. Nur ein Modell, das versteht. Willkommen in der Welt der Physical AI.

Jahrelang lebte Künstliche Intelligenz hinter Bildschirmen. Chatbots, Texterkennung, Bildgeneratoren – alles digital, alles flach. Doch 2026 passiert etwas Merkwürdiges: Die KI verlässt den Rechner. Sie bekommt Augen, Arme, Räder. Sie lernt, wie ein Mensch zu handeln – und zwar nicht metaphorisch.

Physical AI ist der Begriff, der diese Entwicklung beschreibt. Und wer ihn noch nicht kennt, wird ihn bald überall hören. Auf der CES im Januar 2026 in Las Vegas hat Jensen Huang, Chef von NVIDIA, es auf den Punkt gebracht: „The ChatGPT moment for robotics is here.“ Das war kein Marketing-Versprechen. Das war eine Zustandsbeschreibung.

Physical AI bezeichnet KI-Systeme, die nicht nur Daten verarbeiten, sondern unmittelbar in der realen Welt handeln. Sie nehmen ihre Umgebung über Sensoren wahr – Kameras, Lidar, Mikrofone, Tastsensoren – und treffen auf dieser Basis autonome Entscheidungen. Greifen. Fahren. Navigieren. Eingreifen.

Klingt simpel? Ist es nicht. Der Unterschied zu einem klassischen Industrieroboter ist enorm. Traditionelle Maschinen führen starre Programme aus: Bewegungsablauf A, dann B, dann C. Ändert sich etwas – eine andere Kiste, ein neues Bauteil, ein unbekanntes Hindernis – stehen sie ratlos da. Physical AI nicht. Sie erkennt, was sie vor sich hat, und passt sich an.

Wir bei digital-magazin.de haben uns das genauer angeschaut, und ehrlich gesagt war die Lernkurve steil. Denn Physical AI ist kein einzelnes Produkt, keine abgeschlossene Technologie. Es ist eher ein Paradigmenwechsel: Weg von der Maschine, die Befehle ausführt – hin zur Maschine, die denkt.

Dabei ist der Begriff breiter als es zunächst klingt. Humanoide Roboter sind das Paradebeispiel, das die meisten vor Augen haben. Aber auch autonome Fahrzeuge, Drohnen, Chirurgieroboter und smarte Industrieanlagen fallen darunter. Überall dort, wo die wichtigsten KI-Technologien auf einen physischen Körper treffen, der in der Welt agiert, ist Physical AI am Werk.

Die Technologiebeschleuniger sitzen größtenteils in den USA. NVIDIA hat sich in den letzten zwei Jahren zur zentralen Infrastrukturplattform für Physical AI entwickelt – ähnlich wie das Unternehmen einst der Backbone des Deep-Learning-Booms war.

Auf der CES 2026 präsentierte NVIDIA ein ganzes Ökosystem: Neue Open-Source-Modelle, Simulationsframeworks und Compute-Infrastruktur – alles darauf ausgelegt, den Entwicklungszyklus für Roboter zu beschleunigen. Das Herzstück: Isaac GR00T N1.6, ein offenes Vision-Language-Action-Modell, das speziell für humanoide Roboter gebaut wurde. Es versteht visuelle Eingaben, verarbeitet Sprache und übersetzt beides in physische Bewegungen.

Gleichzeitig kommen die NVIDIA Cosmos-Modelle ins Spiel. Dabei handelt es sich um sogenannte World Models – KI-Systeme, die die physikalischen Gesetze der realen Welt simulieren können. Das ist wichtig, denn Roboter können nicht einfach in der echten Welt trainiert werden. Zu teuer, zu langsam, zu gefährlich. Mit Cosmos lässt sich eine realistische digitale Zwillings-Umgebung bauen, in der ein Roboter Millionen von Situationen durchspielt, bevor er zum ersten Mal echten Boden berührt.

Wer mit diesen Technologien arbeitet? Eine beeindruckende Liste. Laut NVIDIA Pressemitteilung von Januar 2026 setzen Boston Dynamics, Caterpillar, Franka Robotics, LG Electronics und NEURA Robotics auf den NVIDIA-Stack. Caterpillar nutzt ihn, um schwere Baumaschinen mit Sprachsteuerung und KI-Assistenten auszurüsten. LG baut Haushaltsroboter. NEURA Robotics aus Metzingen entwickelt humanoide Maschinen für Produktion und Pflege.

Das ist keine Nische mehr. Das ist Industrie.

Es gibt einen Begriff, der in Fachkreisen noch präziser ist: Embodied AI. Also verkörperte KI. Dahinter steckt eine Idee, die aus der Kognitionswissenschaft stammt: Intelligenz entsteht nicht im Vakuum. Sie entsteht durch Interaktion mit einer Umgebung.

Ein Kleinkind lernt nicht, was „schwer“ bedeutet, indem es Texte darüber liest. Es lernt es, indem es Dinge hält, fallen lässt, hochhebt. Genau dieses Prinzip überträgt Embodied AI auf Maschinen. Der Körper ist nicht die Hülle der KI – er ist ein Teil ihrer Lernumgebung.

Das klingt theoretisch, hat aber ganz praktische Konsequenzen. Roboter, die nach dem Embodied-AI-Prinzip trainiert werden, generalisieren besser. Sie können mit unbekannten Objekten umgehen, auf unvorhergesehene Hindernisse reagieren und ihre Bewegungen an veränderte Umgebungen anpassen. Das Münchner Unternehmen robominds, das seit fast zehn Jahren KI-Gehirne für Industrieroboter entwickelt, beschreibt das so: Roboter, die physische KI nutzen, spielen nicht starre Programme ab, sondern sind entscheidungs- und anpassungsfähig.

Mal ehrlich: Das ist der eigentliche Durchbruch. Nicht die humanoide Form. Nicht die Größe. Sondern die Tatsache, dass eine Maschine lernt, wie man mit der Welt umgeht – und das Gelernte auf neue Situationen überträgt.

Dazu kommen neuartige Trainingsmethoden. Reinforcement Learning in Simulationen erlaubt es, Roboter in Millionen von Szenarien zu trainieren, ohne echte Hardware zu beschädigen. Demonstration Learning, also Lernen durch Beobachtung menschlicher Bewegungen, macht es möglich, neue Fähigkeiten mit vergleichsweise wenigen echten Daten zu erwerben. Und Synthetic Data – KI-generierte Trainingsdaten – füllt die Lücken, die echte Datensätze hinterlassen.

Stellen Sie sich eine Fabrikhalle vor. Bisher: Roboterarme, starr programmiert, jeder Griff millimetergenau festgelegt. Ändert sich die Bauteilgröße, muss ein Mensch ran und neu programmieren. Dauert Stunden, manchmal Tage.

Physical AI macht das überflüssig. Ein KI-gestützter Roboterarm erkennt das neue Bauteil, analysiert Form und Gewicht und greift eigenständig – auch wenn er dieses spezifische Teil noch nie gesehen hat. Amazon setzt genau dieses Prinzip mit selbstlernenden Packrobotern um, die durch Erfahrungsdaten aus Millionen Griffen immer besser werden.

Die Einsatzbereiche gehen weit über die Fabrik hinaus. In der Medizin stellt LEM Surgical ein chirurgisches Humanoidsystem vor, das mit NVIDIA-Technologie Spinaloperationen durchführt. In der Landwirtschaft erproben Startups Ernteroboter, die verschiedene Obstarten erkennen und pflücken. In der Logistik rollt autonome Hardware durch Lager und sortiert Pakete ohne menschliche Einweisung.

Was hier passiert, ist die Konvergenz zweier Welten, die lange getrennt waren: die Welt der Software-KI, die in den letzten Jahren enorme Fortschritte gemacht hat, und die Welt der Robotik, die mit ihren langsamen, sperrigen Entwicklungszyklen immer etwas hinterherhinkte. Physical AI bringt beides zusammen.

Das hat Konsequenzen für Unternehmen. Wer verstehen will, wie autonome KI-Systeme bereits heute in Betrieben wirken, bekommt ein Bild davon, wohin die Reise geht – nur dass Physical AI noch einen Schritt weiter geht: Sie agiert nicht nur digital, sondern physisch.

Klar, der Hype ist real. Aber mal kurz innehalten: Was passiert, wenn ein humanoider Roboter einen Fehler macht – nicht in der Simulation, sondern auf dem Fabrikboden? Oder im Pflegeheim? Oder im OP?

Physical AI bringt eine neue Kategorie von Risiken mit sich. Softwarefehler haben Konsequenzen im digitalen Raum – sie lassen sich rückgängig machen, patchen, vergessen. Ein Roboter, der stolpert und eine Person verletzt, hinterlässt keine digitale Spur. Er hinterlässt eine echte.

Die Rechtsfrage ist noch weitgehend ungeklärt. Die FAZ fragte im Februar 2026, wer haftet, wenn Physical AI in der physischen Welt Schaden anrichtet – eine Frage, die Juristen und Ingenieure gleichermaßen beschäftigt. Der EU AI Act adressiert KI-Systeme mit hohem Risiko, aber die Kategorie der autonomen, verkörperten KI war bei seiner Entstehung noch weitgehend Zukunftsmusik.

Hinzu kommt die Frage der Arbeit. Kein seriöser Ökonom bestreitet, dass Physical AI bestimmte Berufsfelder massiv verändern wird. Lagerlogistik, Fertigung, Routinepflege – überall dort, wo repetitive körperliche Arbeit dominiert, sitzt Physical AI in der Poleposition. Das ist keine dystopische Fantasie. Das ist mathematisch.

Was bedeutet das für Beschäftigte? Für Fachkräfte, die jahrzehntelang Erfahrung im Umgang mit Maschinen haben? Für Pflegepersonal, das weiß, wie man mit alten Menschen spricht? Diese Fragen verdienen ehrliche Antworten – nicht Beschwichtigungen.

Kurzum: Physical AI ist mächtig und sie kommt schnell. Das macht es wichtiger, nicht leiser über die Kehrseiten zu reden.

Wer nach Zahlen sucht, findet sie. Und sie sind schwer zu ignorieren.

Goldman Sachs prognostiziert, dass der globale Markt für humanoide Roboter bis 2035 auf 38 Milliarden US-Dollar anwachsen könnte – mehr als das Sechsfache früherer Schätzungen. Fortune Business Insights kalkuliert sogar 66 Milliarden bis 2032. Konservativere Szenarien sprechen von 6 bis 10 Milliarden bis 2030.

Ob 6 oder 66 Milliarden – alle zeigen in dieselbe Richtung: steil nach oben.

Was treibt das Wachstum? Drei Faktoren spielen zusammen. Erstens: Die KI-Modelle sind jetzt gut genug. Was 2022 noch Science-Fiction war, ist 2026 ingenieurstechnische Realität. Zweitens: Die Hardware wird billiger. Sensoren, Aktuatoren, Edge-Computing-Module – die Preise sinken, die Leistung steigt. Drittens: Der Arbeitskräftemangel. In der Fertigung, Logistik und Pflege fehlen Fachkräfte. Physical AI füllt diese Lücke – zumindest teilweise.

Wir bei digital-magazin.de sehen das auch als Chance für kleine und mittlere Unternehmen, die sich bisher keine maßgeschneiderte Robotik leisten konnten. Wenn Plattformen wie die von NVIDIA auf Open-Source setzen und KI-Modelle frei verfügbar werden, sinkt die Einstiegshürde. Was bisher dem Volkswagen-Konzern vorbehalten war, könnte schon bald auch für den Mittelständler aus dem Schwarzwald erschwinglich sein.

Das ist keine Garantie. Aber es ist eine Möglichkeit – und Möglichkeiten sollten beim Namen genannt werden.

Physical AI ist nicht der nächste Hype-Zyklus, der in zwei Jahren wieder verpufft. Die technologischen Grundlagen sind da. Die Plattformen werden gebaut. Die ersten echten Produkte laufen in echten Fabriken.

Aber der Weg von „läuft in kontrollierten Laborbedingungen“ zu „arbeitet zuverlässig in chaotischen Alltagsumgebungen“ ist länger, als Pressemitteilungen suggerieren. Kaum jemand in der Branche glaubt, dass humanoide Roboter 2026 massenweise in Büros stehen. 2030? Realistischer. 2035? Sehr wahrscheinlich.

Was in den nächsten zwei, drei Jahren passieren wird: Physical AI dringt in klar definierte, wiederholbare Aufgaben vor. Lagerverwaltung. Qualitätskontrolle. Chirurgische Assistenz. Bereiche, in denen die Umgebung halbwegs vorhersehbar ist und Fehler tolerierbar sind – oder zumindest kontrollierbar.

Wer sich für die Funktionsweise autonomer KI-Agenten interessiert, bekommt durch Physical AI eine ganz neue Dimension: Diese Agenten handeln nicht nur in Software – sie greifen zu, fahren los, schneiden auf. Das ist eine andere Größenordnung von Autonomie. Und sie erfordert eine andere Größenordnung von Verantwortung.

Die Frage ist nicht, ob Physical AI kommt. Die Frage ist, ob wir als Gesellschaft bereit sind für das, was kommt – und ob wir die Regeln dafür schreiben, bevor die Maschinen sie für uns aufstellen.

Um Ihnen ein optimales Erlebnis zu bieten, verwenden wir Technologien wie Cookies, um Geräteinformationen zu speichern und/oder darauf zuzugreifen. Wenn Sie diesen Technologien zustimmen, können wir Daten wie Ihr Surfverhalten oder eindeutige IDs auf dieser Website verarbeiten. Wenn Sie Ihre Zustimmung nicht erteilen oder widerrufen, können bestimmte Merkmale und Funktionen beeinträchtigt werden.