Was Unternehmen jetzt umsetzen müssen, um Bußgelder zu vermeiden und rechtskonform mit KI-Anwendungen zu arbeiten.

Künstliche Intelligenz ist längst kein bloßes Experimentierfeld mehr. Während der Fokus zuletzt im Zeichen des Ausprobierens stand, markiert die kommende Zeit den Übergang zu einer verbindlichen Regulierung. Mit dem EU AI Act (KI-Verordnung) hat die EU das weltweit erste umfassende Gesetz für Künstliche Intelligenz geschaffen. Für Unternehmen bedeutet das: Wer KI nutzt, entwickelt oder vertreibt, muss sich jetzt strukturiert auf die neuen Pflichten vorbereiten. Die Übergangsphase läuft.

Der AI Act ist dabei weit mehr als ein bürokratisches Hindernis. Er bietet die Chance, „AI made in Europe“ als Qualitätssiegel für Vertrauen und Sicherheit zu etablieren.

Der EU AI Act folgt einem risikobasierten Ansatz. Je potenziell stärker eine KI-Anwendung Grundrechte oder Sicherheit beeinträchtigen kann, desto strenger sind die Anforderungen.

Der AI Act untersagt bestimmte KI-Praktiken grundsätzlich. Dazu zählen unter anderem Social Scoring durch Behörden, biometrische Echtzeit-Überwachung im öffentlichen Raum sowie stark manipulative Techniken. Unternehmen stehen in der Pflicht sicherzustellen, dass weder offiziell eingesetzte Systeme noch „Schatten-KI“ in diese Verbotskategorie fallen.

Für Hochrisiko-Systeme gelten stufenweise umfangreiche Pflichten, die in der Breite wirksam werden. Dazu gehören unter anderem KI-Anwendungen in Bereichen wie:

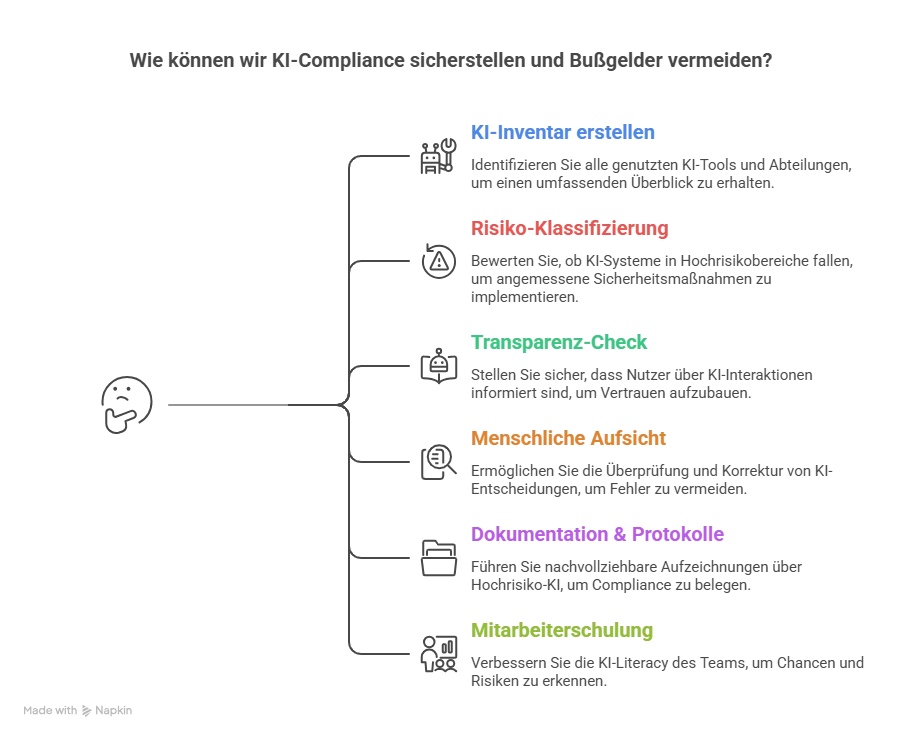

Hier sind insbesondere Risikomanagement, Daten- und Modellqualität, technische Dokumentation, Transparenz sowie menschliche Aufsicht vorgeschrieben.

Für bestimmte KI-Systeme mit begrenztem Risiko, wie etwa Chatbots oder Tools zur Erzeugung synthetischer Inhalte (z. B. Deepfakes), gelten vor allem Transparenzanforderungen. Nutzerinnen und Nutzer müssen erkennen können, dass sie mit einer KI interagieren beziehungsweise dass Inhalte künstlich erzeugt wurden. Ein klarer Hinweis wie „Sie kommunizieren mit einem KI-System“ wird in solchen Fällen zum Standard.

Die größte Herausforderung für kleine und mittlere Unternehmen ist oft die Bestandsaufnahme, da in vielen eingekauften Software-Lösungen bereits KI steckt. Dies betrifft teilweise auch Funktionen, die in Richtung Hochrisiko gehen.

Ein wichtiger Praxispunkt ist hierbei, dass Unternehmen, die KI-Systeme in ihrem Betrieb einsetzen, eine Mitverantwortung für deren rechtskonforme Nutzung tragen. Dies gilt selbst dann, wenn die Technologie von einem Drittanbieter stammt. Das betrifft insbesondere Software in Bereichen wie Buchhaltung oder HR, da diese ohnehin regelmäßig an neue gesetzliche Vorgaben angepasst werden muss. Um hier den Überblick zu behalten, sind praxisnahe Ressourcen wie dieses E-Book zu aktuellen Gesetzesänderungen hilfreich. Es unterstützt Verantwortliche dabei, regulatorische Neuerungen strukturiert zu erfassen und rechtzeitig in die betrieblichen Prozesse zu integrieren.

Frage: Müssen wir auch für einfache Schreibassistenten ein Risikomanagement einführen?

Antwort: Für KI-Systeme mit minimalem Risiko, wozu beispielsweise reine Rechtschreib- oder Grammatik-Hilfen ohne Entscheidungscharakter zählen, sieht der EU AI Act keine spezifischen Pflichten vor. In diesen Fällen werden lediglich freiwillige Verhaltenskodizes empfohlen. Sobald ein Schreibassistent jedoch Entscheidungen vorbereitet oder maßgeblich beeinflusst, etwa in HR- oder Compliance-Prozessen, sollte geprüft werden, ob strengere Regeln greifen.

Frage: Was passiert, wenn wir ein KI-Tool eines US-Anbieters nutzen?

Antwort: Der AI Act gilt für alle KI-Systeme, die in der EU in Verkehr gebracht oder genutzt werden, unabhängig vom Sitz des Anbieters. Unternehmen in der EU müssen daher sicherstellen, dass eingesetzte Systeme die Anforderungen der Verordnung erfüllen. Dies kann durch geeignete Informationen, vertragliche Zusicherungen sowie technische Prüfungen seitens des Anbieters erfolgen.

Frage: Wie hängen DSGVO und AI Act zusammen?

Antwort: Beide Regelwerke ergänzen sich gegenseitig. Während der AI Act vor allem die Sicherheit, Governance und Transparenz von KI-Systemen adressiert, regelt die DSGVO weiterhin den Schutz personenbezogener Daten. Compliance-Verantwortliche müssen daher beide Perspektiven, also Produkttechnik und Datenschutz, gemeinsam im Blick behalten.

Die rechtlichen Leitplanken des EU AI Acts bilden das notwendige Fundament für den Einsatz künstlicher Intelligenz in Europa. Doch die Einhaltung der neuen Verordnung ist nur der erste Schritt zu einer erfolgreichen digitalen Strategie. In der täglichen Unternehmenspraxis müssen diese Anforderungen mit bestehenden Gesetzen wie der DSGVO harmonisiert werden, um sowohl rechtssicher als auch effizient zu arbeiten.

Wie eine solche Umsetzung konkret aussehen kann, zeigt unser vertiefender Hintergrundbericht über DSGVO-konforme AI-Workflows im Marketing. Dort erfahren Sie, wie die Synergie aus Datenschutz und technologischer Innovation in einem der dynamischsten Geschäftsbereiche gelingt.

Der EU AI Act fungiert als notwendiges Leitplankensystem für eine digitalisierte Wirtschaft. Unternehmen mit einer frühzeitigen AI-Governance schützen sich vor Sanktionen und stärken gleichzeitig das Vertrauen von Kunden sowie Partnern, da ethischer KI-Einsatz zunehmend kaufentscheidend wirkt.

In einem dynamischen Umfeld aus Technologie und Recht bleibt kontinuierliche Information die beste Versicherung. Wer Klassifizierung sowie Dokumentation sorgfältig umsetzt, nutzt die Innovationskraft der KI sicher und erzielt ein klares Plus an Wettbewerbsfähigkeit.

Um Ihnen ein optimales Erlebnis zu bieten, verwenden wir Technologien wie Cookies, um Geräteinformationen zu speichern und/oder darauf zuzugreifen. Wenn Sie diesen Technologien zustimmen, können wir Daten wie Ihr Surfverhalten oder eindeutige IDs auf dieser Website verarbeiten. Wenn Sie Ihre Zustimmung nicht erteilen oder widerrufen, können bestimmte Merkmale und Funktionen beeinträchtigt werden.