Lisa Hartmann

Lisa Hartmann

Agentic AI und autonome Trading-Systeme: Das klingt nach Science-Fiction – ist es aber längst nicht mehr. KI-Agenten, die selbstständig Märkte scannen, Fraud stoppen und Kreditentscheidungen vorbereiten, verändern den Bankensektor gerade schneller, als es den meisten Regulatoren lieb ist. Was das konkret bedeutet, was es kostet, was es bringt – und wo der Haken steckt.

Rechnen wir nach: Rund 80 bis 90 Prozent aller Daten, die im Banking täglich anfallen, sind unstrukturiert – Vertragstexte, E-Mails, Handelsnotizen, Compliance-Dokumente, Kundenkorrespondenz. Klassische Automatisierung, die auf festen Regeln basiert, beißt sich daran die Zähne aus. Agentic AI nicht. Diese Systeme lesen, interpretieren, schlussfolgern und handeln – ohne dass ein Mensch jeden Schritt anstoßen muss.

Der Unterschied zu herkömmlicher KI ist fundamental. Ein klassischer Chatbot wartet auf Ihre Anfrage und gibt eine Antwort. Ein KI-Agent hingegen setzt sich selbst Ziele, bricht diese in Teilschritte auf, führt externe Tools aus, überprüft Zwischenergebnisse und korrigiert den Kurs, wenn etwas nicht stimmt. Konkret: Er kauft nicht, wenn Sie ihn fragen. Er kauft, weil er erkannt hat, dass die Marktlage es jetzt nahelegt – und weil Sie ihm das als übergeordnetes Ziel mitgegeben haben.

Für autonome Trading-Systeme bedeutet das einen Paradigmenwechsel. Bisher waren algorithmische Handelssysteme im Wesentlichen regelbasiert: Wenn Preis X unterschritten wird, verkaufe Y. Agentic AI bricht aus diesem starren Schema aus. Sie analysiert Sentiment aus Nachrichtenquellen, kombiniert Makrodaten mit Orderbook-Informationen, passt Modelle in Echtzeit an veränderte Volatilität an – und trifft Entscheidungen, die ein menschlicher Trader so nicht binnen Millisekunden treffen könnte.

Meine persönliche Einschätzung: Der Begriff „Disruption“ wird im Tech-Journalismus inflationär eingesetzt, aber im Fall von Agentic AI im Banking ist er ausnahmsweise angebracht. Was hier passiert, ist keine inkrementelle Verbesserung bestehender Prozesse. Es ist ein Eingriff in die DNA des Bankbetriebs – von der Kreditvergabe über das Trading bis zum Compliance-Management.

Autonome Trading-Systeme auf Basis von Agentic AI sind noch nicht flächendeckend im produktiven Einsatz. Das ist wichtig zu betonen. Was heute in Pilotprojekten erprobt wird, klingt dennoch beeindruckend – und die Richtung ist klar. Semantisch passt dazu unser Hintergrund Agentic AI: Wie autonome Geschäftsprozesse Unternehmen 2026 verändern.

Konkret können solche Systeme mehrere Datenströme simultan verarbeiten: Börsenkurse, Nachrichtenfeeds, Social-Media-Sentiment, Regulierungsdokumente, makroökonomische Indikatoren. Ein Agentic-AI-System orchestriert dabei spezialisierte Unter-Agenten, die jeweils für eine Datenquelle zuständig sind, und fasst deren Ergebnisse zu einer Handelsentscheidung zusammen.

Zum Vergleich: Ein klassisches quant-getriebenes System bei einer Investment-Bank benötigt Teams von Entwicklern, um Modelle anzupassen, wenn sich Marktregimes ändern – etwa in einer Krise wie im März 2020. Ein Agentic-AI-System, das auf unstrukturierten Daten trainiert ist, kann diesen Regimewechsel potenziell selbst erkennen und seine Parameter neu kalibrieren. Das ist der Kern des Wertversprechens.

Die Realität ist allerdings nüchterner. Laut Citi Research befinden sich autonome Execution-Systeme auf Agentic-AI-Basis noch im Pilotstadium. Die großen Einsatzgebiete, in denen Agentic AI heute bereits messbare Wirkung erzielt, liegen im Fraud-Management, im Onboarding und in der Compliance-Automatisierung – nicht im vollautonomen Handel mit realen Marktpositionen. Wer das Gegenteil behauptet, verkauft Ihnen Marketing, keine Technik.

Der Begriff Deep-Tech-Banking beschreibt Banken, die nicht nur KI-Tools an ihre bestehende IT kleben, sondern ihre Kernprozesse von Grund auf mit KI-nativen Architekturen neu aufsetzen. Agentic AI spielt dabei eine zentrale Rolle – aber sie stößt auch auf ein fundamentales Problem: die Legacy-IT.

Rechnen wir nach: Effizienzraten bei traditionellen Banken liegen Schätzungen zufolge bei rund 60 Prozent – das heißt, 40 Prozent der Prozesskapazität verpufft in manuellen Schritten, Medienbrüchen und redundanten Prüfungen. Siloierte Datensysteme sollen Banken bis zu 30 Prozent des Jahresumsatzes kosten, weil Chancen verpasst, Risiken spät erkannt und Kundenwünsche falsch eingeschätzt werden. Diese Zahlen stammen aus Branchenmodellen – sie sind also mit Vorsicht zu genießen, zeigen aber die Größenordnung des Problems.

Deep-Tech-Banking adressiert genau diese Ineffizienz. Konkret bedeutet das: KI-Agenten, die über API-Schichten mit Core-Banking-Systemen kommunizieren, Kreditentscheidungen automatisch dokumentieren und Compliance-Reports in Echtzeit generieren. Der Haken: Diese Integration ist technisch anspruchsvoll und regulatorisch komplex. § 25a KWG (in Deutschland) schreibt vor, dass wesentliche Auslagerungen von IT-Systemen und Prozessen besonderer Kontrolle bedürfen – und autonome KI-Entscheidungen fallen potenziell in diese Kategorie.

Matthias Plattner von der Bank Julius Bär spricht in diesem Kontext von der „Agentic Bank“ – einem Institut, in dem autonome KI-Systeme fester Bestandteil des operativen Betriebs sind, mit tiefgreifenden Änderungen in Prozessen und Verantwortlichkeiten. Das ist eine Vision, keine gegenwärtige Realität. Aber sie beschreibt, wo die Reise hingeht.

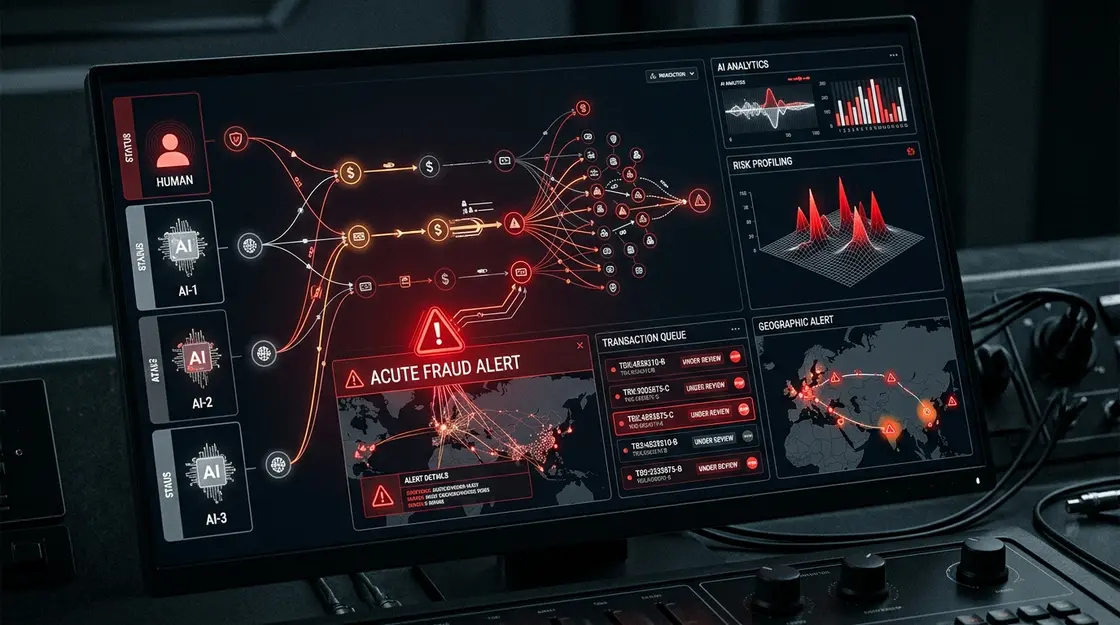

Wenn es einen Bereich im Banking gibt, in dem Agentic AI heute schon konkreten Unterschied macht, dann ist es die Betrugserkennung. Und die Zahlen sind deutlich: 77 Prozent der Verbraucher sind laut Salesforce-Daten daran interessiert, KI zur Fraud-Prävention einzusetzen. Der weltweite Markt für KI-gestützte Fraud-Detection könnte laut Prognosen auf über 200 Milliarden US-Dollar bis 2034 wachsen – wobei diese Zahl auf Marktmodellen basiert und entsprechend mit Unsicherheiten behaftet ist.

Was macht Agentic AI in der Fraud-Detection konkret besser als regelbasierte Systeme? Sie erkennt unbekannte Muster. Ein regelbasiertes System fängt Transaktionen, die gegen bekannte Betrugsmuster verstoßen. Ein Agentic-AI-System kann anomale Verhaltensmuster in Echtzeit identifizieren, auch wenn es diese Betrugsart noch nie gesehen hat – weil es Kontext versteht, nicht nur Regeln prüft.

Zum Vergleich: Bei einem klassischen Schwellenwert-System würde eine Überweisung von 9.999 Euro nicht auffallen, weil sie unter dem 10.000-Euro-Meldeschwellenwert liegt. Ein Agentic-AI-System, das den Transaktionsverlauf des Kunden kennt, erkennt, dass diese Person normalerweise maximal 500 Euro überweist – und leitet eine Prüfung ein, bevor der Schaden entsteht. Das ist der Unterschied zwischen reaktiver Compliance und proaktivem Schutz.

Konkret bedeutet das für eine mittelgroße Privatkundenbank: Wenn sie bisher eine Fraud-Rate von 0,3 Prozent des Transaktionsvolumens hatte und dieses Volumen bei 10 Milliarden Euro jährlich liegt, sprechen wir von 30 Millionen Euro Fraud-Schaden. Eine Reduktion um auch nur 20 Prozent durch Agentic AI wäre unter dem Strich eine Einsparung von 6 Millionen Euro – und das ist eine konservative Schätzung.

Wer über autonome Trading-Systeme schreibt, ohne die Regulierung zu erwähnen, tut seinen Lesern keinen Gefallen. Der EU AI Act, der seit August 2024 in Kraft ist und mit gestaffelten Fristen bis 2027 umgesetzt werden muss, stuft bestimmte KI-Systeme im Finanzbereich als Hochrisiko-Systeme ein. Konkret: KI-Systeme, die für die Kreditwürdigkeitsprüfung und Risikobeurteilung natürlicher Personen eingesetzt werden, fallen unter Anhang III des AI Acts und unterliegen strengen Anforderungen an Transparenz, Dokumentation und menschliche Aufsicht.

Für autonome Trading-Systeme, die an Kapitalmärkten operieren, greift zusätzlich die MiFID-II-Regulierung (Markets in Financial Instruments Directive). Artikel 17 MiFID II verpflichtet Wertpapierfirmen, die algorithmischen Handel betreiben, zu wirksamen Systemen und Kontrollen, um sicherzustellen, dass die Systeme nicht zu einem ungeordneten Markt beitragen oder anderweitig gegen die Vorschriften verstoßen.

Der Haken bei Agentic AI: Genau die Eigenschaften, die sie so leistungsfähig machen – Autonomie, Lernfähigkeit, Selbstkorrektur – erschweren die Erfüllung dieser regulatorischen Anforderungen. Wie dokumentiert man Entscheidungen eines Systems, das seine eigenen Modelle adaptiert? Wie stellt man sicher, dass ein autonomer Agent nicht unbeabsichtigt Marktmanipulation betreibt?

Zur regulatorischen Lage in Deutschland kommt noch ein weiteres Problem: Laut einer Bitkom-Analyse bremst Bürokratie FinTechs in Deutschland massiv aus. Genehmigungsverfahren, die in anderen EU-Ländern Monate dauern, ziehen sich hierzulande oft deutlich länger hin. Für Startups, die Agentic-AI-basierte Trading-Plattformen entwickeln, kann das existenzbedrohend sein – während internationale Konkurrenten aus weniger regulierten Jurisdiktionen schneller an den Markt kommen.

Der Bank-Blog veröffentlichte Ende April 2026 eine Analyse zu disruptiven Technologien, die auf eine interessante Kombination hinweist: Agentic AI zusammen mit VIBE-Coding – also KI-gestützter Programmierung, bei der Entwickler in natürlicher Sprache beschreiben, was Code tun soll, und die KI den Code generiert und testet. Das ist relevant, weil es die Entwicklungsgeschwindigkeit für autonome Trading-Systeme dramatisch verändert.

Konkret: Ein Trading-Desk einer mittelgroßen Bank, der früher drei bis sechs Monate Entwicklungszeit benötigte, um einen neuen algorithmischen Handelsansatz zu implementieren, kann mit VIBE-Coding und Agentic AI diesen Zyklus auf Wochen verkürzen. Das hat einen enormen Wettbewerbseffekt – und es erhöht gleichzeitig das Risiko, weil weniger Zeit für manuelle Code-Reviews und Sicherheitstests bleibt.

Rechnen wir nach: Eine Entwicklerstunde kostet bei einem erfahrenen quant developer in Frankfurt grob 150 bis 200 Euro. Ein dreimonatiges Projekt mit einem fünfköpfigen Team bedeutet etwa 1.800 Entwicklerstunden – Kosten von 270.000 bis 360.000 Euro, nur für die Entwicklung. Wenn VIBE-Coding diesen Aufwand halbiert, sind das 135.000 bis 180.000 Euro eingesparte Entwicklungskosten pro Projekt. Für eine Bank, die zwanzig solcher Projekte pro Jahr fährt, summiert sich das auf 2,7 bis 3,6 Millionen Euro jährliche Einsparungen allein bei den Entwicklungskosten.

Unter dem Strich ist die Kombination von Agentic AI und VIBE-Coding im Deep-Tech-Banking ein echter Beschleuniger. Sie demokratisiert die Entwicklung komplexer Finanzsysteme und senkt Einstiegshürden für Startups, die gegen etablierte Institute antreten wollen. Das ist gut für Innovation – und herausfordernd für Compliance-Teams, die mit der Geschwindigkeit Schritt halten müssen.

Interessanterweise sind Kryptomärkte das natürliche Experimentierlabor für Agentic AI im Trading. Warum? Weil sie 24/7 laufen, weil sie weniger reguliert sind als traditionelle Kapitalmärkte, und weil ihre extreme Volatilität genau die Art von Echtzeit-Anpassungsfähigkeit verlangt, die Agentic AI bieten kann.

Autonome Trading-Systeme, die auf KI-Agenten basieren, werden im Krypto-Bereich bereits eingesetzt. Sie analysieren On-Chain-Daten, Wallet-Bewegungen von Großinvestoren (sogenannte „Whale Alerts“), Sentiment auf sozialen Plattformen und technische Chartmuster – simultan und in Echtzeit. Das Ergebnis sind Handelsentscheidungen, die menschliche Trader nicht in dieser Geschwindigkeit und Datentiefe treffen könnten. Semantisch passt dazu unser Hintergrund Agentic AI im Unternehmen: Wenn KI-Systeme selbstständig Entscheidungen treffen.

Zum Vergleich: Ein menschlicher Krypto-Trader, der 12 Stunden täglich arbeitet, kann vielleicht fünf bis zehn Datenpunkte gleichzeitig überwachen. Ein Agentic-AI-Trading-System kann Hunderte von Token, Dutzende von Exchanges und tausende von On-Chain-Signalen parallel verfolgen. Das ist kein marginaler Vorteil – das ist ein struktureller Informationsvorsprung.

Der Haken: Auch im Krypto-Bereich wächst die Regulierung. Die EU-Kryptoregulierung MiCA (Markets in Crypto-Assets Regulation) gilt seit Ende 2024 vollumfänglich und stellt auch für KI-gestützte Krypto-Handelssysteme neue Anforderungen. Wer autonome Trading-Systeme für Kryptowährungen betreibt, muss sich mit den Anforderungen an Marktintegrität und Betreiberverantwortung auseinandersetzen – auch wenn das im Krypto-Space noch längst nicht überall gelebt wird.

Für traditionelle Banken, die Krypto-Assets in ihr Portfolio integrieren wollen, eröffnet die Kombination aus MiCA-Compliance und Agentic-AI-gestützten autonomen Trading-Systemen eine interessante Möglichkeit: Systeme, die regulatorische Anforderungen automatisch überwachen und sicherstellen, dass alle Trades innerhalb der zulässigen Parameter bleiben. Compliance as a Feature, nicht als Belastung.

Neben der Fraud-Detection ist das Kundeonboarding der zweite Bereich, in dem Agentic AI im Banking heute schon reale Wirkung zeigt. Das ist kein Zufall: Onboarding ist ein Prozess, der enorm viele unstrukturierte Daten verarbeitet – Ausweisdokumente, Gehaltsabrechnungen, Kontoauszüge, Adressnachweise – und trotzdem klare regulatorische Anforderungen erfüllen muss (KYC, AML).

Konkret: Ein traditionelles Onboarding-Verfahren bei einer deutschen Privatkundenbank dauert im Schnitt drei bis fünf Werktage. Ein Agentic-AI-System kann relevante Dokumente auslesen, gegen Datenbanken prüfen, Risikoklassen zuweisen und einen Entscheidungsvorschlag generieren – in Minuten. Der Mensch prüft dann den Vorschlag, statt den gesamten Prozess manuell durchzuführen.

Rechnen wir nach: Eine Bank mit 50.000 Neukundenanträgen pro Jahr und einem durchschnittlichen Bearbeitungsaufwand von 90 Minuten pro Antrag kommt auf 75.000 Personenstunden jährlich. Bei einem internen Stundensatz von 60 Euro (inklusive Overhead) sind das 4,5 Millionen Euro reine Prozesskosten für das Onboarding. Wenn Agentic AI diesen Aufwand auf 15 Minuten Prüfzeit pro Antrag reduziert (was realistisch ist), sinken die Kosten auf 750.000 Euro – eine Einsparung von 3,75 Millionen Euro. Das ist echte Rendite, keine Theorie.

Gartner prognostiziert, dass bis 2029 rund 80 Prozent der Kundensupport-Probleme ohne menschliche Intervention gelöst werden – auch das ist ein Effekt von Agentic AI, der eng mit dem Onboarding-Prozess und dem laufenden Kundenservice zusammenhängt. Diese Prognose ist ambitioniert; sie setzt voraus, dass sowohl die Technologie als auch das Kundenvertrauen in autonome Systeme entsprechend wachsen.

74 Prozent der Bankkunden erwarten personalisierte Erlebnisse. Gleichzeitig haben mehr als 50 Prozent der Führungskräfte in Finanzinstituten keinen einheitlichen Blick auf ihre Kundendaten. Das ist ein klassisches Paradox: Die Erwartung ist hoch, die Datengrundlage ist fragmentiert, und klassische Ansätze zur Personalisierung scheitern an den Silos. Semantisch passt dazu unser Hintergrund Guide to Next 2026: Das große KI-Paradox der Unternehmen.

Agentic AI löst dieses Problem potenziell, indem sie Daten aus unterschiedlichen Quellen – Transaktionshistorie, Produktnutzung, Kommunikationspräferenzen, externe Kontextdaten – zusammenführt und daraus personalisierte Handlungsempfehlungen ableitet. Nicht als statischer Report, sondern als dynamische, kontinuierlich aktualisierte Empfehlung.

Für autonome Trading-Systeme bedeutet das: Ein Agentic-AI-System kann das individuelle Risikoprofil eines institutionellen Kunden in Echtzeit berücksichtigen und Trading-Strategien entsprechend anpassen. Ein Hedgefonds mit konservativem Mandat bekommt andere Signale als ein Family Office mit spekulativem Ansatz – obwohl beide dasselbe System nutzen. Das ist Personalisierung auf einem Level, das manuell schlicht nicht skalierbar wäre.

Der Haken: Personalisierung erfordert Daten. Mehr Daten bedeuten mehr Datenschutz-Verantwortung. Die DSGVO (Datenschutz-Grundverordnung) setzt hier enge Grenzen, und die Interaktion von DSGVO und KI Act schafft eine regulatorische Gemengelage, die selbst gut aufgestellte Compliance-Teams herausfordert. Wer KI-gestützte Personalisierung falsch implementiert, riskiert nicht nur Bußgelder nach Art. 83 DSGVO, sondern auch Reputationsschäden, die schwer zu quantifizieren, aber leicht zu vermeiden wären.

Die eigentlich interessante Frage ist nicht, ob Agentic AI den Bankensektor verändert. Das tut sie. Die Frage ist: Wer profitiert davon? Und die Antwort ist weniger eindeutig, als es die Marketing-Abteilungen großer Technologiekonzerne glauben machen wollen.

Einerseits haben etablierte Banken den Vorteil: Kundenvertrauen, Kapital, regulatorische Lizenzen und historische Daten – letztere sind der wichtigste Rohstoff für KI-Systeme. Eine Bank, die seit 30 Jahren Transaktionsdaten ihrer Kunden speichert, hat einen Datenvorteil, den ein FinTech-Startup nicht so schnell aufholen kann.

Andererseits: Agile FinTechs ohne Legacy-IT können Agentic-AI-Systeme auf der grünen Wiese aufbauen – ohne die Kompromisse, die eine Integration in jahrzehntealte Mainframe-Systeme mit sich bringt. Laut Citi Research wächst die Konkurrenz durch Startups genau in dem Maß, wie Agentic AI die Kosten für den Aufbau leistungsfähiger Finanzsysteme senkt. Die „Do It For Me“-Economy – Kunden, die von ihrer Bank erwarten, dass sie alles autonom erledigt – spielt FinTechs in die Hände, die genau das als Kernversprechen haben.

Zum Vergleich: Eine traditionelle Investmentbank benötigt laut Branchenschätzungen typischerweise 18 bis 24 Monate, um ein neues algorithmisches Trading-System von der Konzeption bis zum produktiven Einsatz zu bringen. Ein DeepTech-FinTech, das auf moderne Cloud-Infrastruktur, VIBE-Coding und Agentic AI setzt, kann denselben Weg in sechs bis neun Monaten gehen. Das ist ein Wettbewerbsunterschied, der sich über einige Jahre in Marktanteilen niederschlägt – wie die FinTech-Szene aktuell beobachtet.

Unter dem Strich: Nicht die größten Banken werden von Agentic AI am stärksten profitieren, sondern jene Institute, die am schnellsten lernen, autonome Systeme in ihre Prozesse zu integrieren und dabei regulatorische Anforderungen nicht als Bremse, sondern als Designprinzip zu verstehen.

Kein Artikel über Agentic AI im Banking wäre komplett ohne die Frage: Was passiert, wenn es schiefläuft? Und autonome Systeme können schiefgehen – durch unvorhergesehene Marktkonstellationen, durch Datenfehler, durch Trainingsdaten, die historische Biases enthalten.

70 Prozent der Konsumenten fordern laut Branchenerhebungen Transparenz darüber, wie KI-Systeme Entscheidungen treffen. Das ist eine hohe Anforderung an Explainability – und sie ist regulatorisch gedeckt. Der EU AI Act verlangt von Hochrisiko-KI-Systemen explizit, dass ihre Entscheidungen für Menschen nachvollziehbar sein müssen. „Black Box“-Modelle, die nur ein Ergebnis ausgeben, ohne den Rechenweg zu erklären, sind in regulierten Finanzbereichen schlicht nicht zulässig.

Für autonome Trading-Systeme ist das eine besondere Herausforderung. Je komplexer die Agenten-Architektur, desto schwieriger wird die Explainability. Wenn ein Multi-Agenten-System aus sieben spezialisierten Unter-Agenten eine Handelsentscheidung trifft, welcher Agent ist dann verantwortlich? Und wer haftet, wenn der Trade zu einem Verlust führt?

Das ist keine abstrakte Frage. Nach § 280 BGB haftet derjenige für Schäden, der eine Pflichtverletzung begeht. Bei autonomen KI-Systemen ist die Frage der Pflichtverletzung und der Haftungszuordnung rechtlich noch nicht abschließend geklärt – weder in Deutschland noch auf EU-Ebene. Die EU KI-Haftungsrichtlinie, die parallel zum AI Act entwickelt wird, soll hier Klarheit schaffen, ist aber noch nicht in nationales Recht umgesetzt.

Meine zweite persönliche Einschätzung: Banken, die jetzt in Agentic AI investieren, ohne gleichzeitig in Governance-Frameworks und Explainability-Tools zu investieren, bauen auf einem sandigen Fundament. Die Technologie allein ist nicht die Herausforderung. Die Herausforderung ist, sie so einzubauen, dass man im Zweifelsfall vor einem Regulierer oder vor Gericht erklären kann, warum das System wie gehandelt hat.

Ein besonders sensibler Bereich ist die KI-gestützte Kreditentscheidung. Hier trifft die Leistungsfähigkeit von Agentic AI auf ein fundamentales ethisches und rechtliches Risiko: Diskriminierung.

Konkret: Wenn ein Agentic-AI-System Kreditentscheidungen auf Basis historischer Daten trifft, besteht die Gefahr, dass historische Benachteiligungen einzelner Gruppen in die KI-Entscheidungen eingeflossen sind. Das ist kein hypothetisches Problem – es ist ein dokumentiertes Phänomen in KI-Systemen weltweit. Im Bankensektor ist es besonders heikel, weil § 19 AGG (Allgemeines Gleichbehandlungsgesetz) die Diskriminierung beim Zugang zu Finanzdienstleistungen ausdrücklich verbietet.

Deep-Tech-Banking-Ansätze, die Agentic AI für Kreditvergabe einsetzen, müssen daher aktiv gegen Bias testen – und diese Tests dokumentieren. Das ist aufwendig, aber nicht optional. Wer glaubt, dass ein gut trainiertes Modell automatisch fair ist, unterschätzt das Problem. Die EU-KI-Behörde (AI Office), die seit Anfang 2024 aktiv ist, hat angekündigt, Hochrisiko-KI-Systeme im Finanzbereich zu prüfen.

Unter dem Strich ist die Kreditentscheidung per Agentic AI ein zweischneidiges Schwert: Sie kann fairer sein als ein menschlicher Sachbearbeiter, der von Sympathie und Tagesform beeinflusst wird – oder sie kann systematisch diskriminieren, ohne dass es jemand bemerkt. Der Unterschied liegt in der Qualität der Implementierung und des Testings.

Was bedeutet das alles konkret für Finanzinstitute, die nicht das Rennen verschlafen wollen? Hier sind keine abstrakten Empfehlungen, sondern konkrete Schritte, die unter dem Strich den Unterschied machen.

Erstens: Datenstrategie vor KI-Strategie. Agentic AI ist nur so gut wie die Daten, auf denen sie operiert. Banken, die ihre Datensilos nicht aufgelöst haben, werden mit autonomen Trading-Systemen keine Rendite erzielen. Der erste Schritt ist eine Bestandsaufnahme: Welche Daten existieren wo, in welchem Format, mit welcher Qualität? Ohne diese Grundlage ist jede KI-Investition verbranntes Geld.

Zweitens: Piloten mit klaren KPIs. Agentic AI sollte nicht flächendeckend ausgerollt werden, bevor sie in kontrollierten Pilotprojekten bewiesen hat, dass sie hält, was sie verspricht. Konkret: Einen Piloten in der Fraud-Detection starten, messbare Ziele setzen (Fraud-Rate, False-Positive-Rate, Bearbeitungszeit) und nach sechs Monaten nüchtern auswerten.

Drittens: Regulatorisches Monitoring einbauen. Wer autonome Trading-Systeme oder KI-gestützte Kreditentscheidungen plant, muss von Beginn an die regulatorischen Anforderungen als Designprinzip mitdenken. AI Act, MiFID II, DSGVO, KWG – das sind keine Nachbetrachtungen, sondern Architekturvorgaben.

Viertens: In Governance investieren. Ein Agentic-AI-System braucht Guardrails – definierte Grenzen, innerhalb derer es autonom handeln darf, und klare Eskalationspfade, wenn es diese Grenzen erreicht. Ohne Governance-Framework ist jedes autonome System ein unkontrolliertes Risiko.

Fünftens: Mitarbeitende qualifizieren, nicht ersetzen. Agentic AI verändert Jobrollen, aber sie macht Banker nicht überflüssig. Die Idee, dass autonome Systeme menschliche Expertise einfach ersetzen, ist falsch. Was sich ändert: Banker müssen lernen, mit KI-Agenten zusammenzuarbeiten, deren Entscheidungen zu interpretieren und zu überwachen. Das erfordert neue Kompetenzen – und konkrete Qualifizierungsinvestitionen.

Es wäre unehrlich, das Thema Agentic AI im deutschen Bankensektor zu behandeln, ohne den Elefanten im Raum zu benennen: Deutschland tut sich schwer, regulatorische Agilität mit Innovationsoffenheit zu verbinden. Das ist keine antiregulatorische Position – Regulierung ist wichtig und richtig. Aber die Art und Weise, wie Genehmigungsverfahren für FinTechs gestaltet sind, ist ein Problem.

Bürokratie bremst FinTechs in Deutschland aus: Das ist kein journalistischer Aufmacher, sondern ein belegter Befund. Lange Genehmigungszeiten, unklare Zuständigkeiten zwischen BaFin, Bundesbank und Datenschutzbehörden, und fehlende regulatorische Sandkästen für echte KI-Experimente im Finanzbereich – das sind strukturelle Hemmnisse, die innovativen Unternehmen das Leben schwerer machen als nötig.

Konkret: Ein Startup, das ein Agentic-AI-Trading-System in Deutschland lizenzieren will, navigiert durch MiFID-II-Anforderungen, AI-Act-Compliance, BaFin-Zulassungsverfahren und DSGVO-Anforderungen – parallel und ohne integrierte Anlaufstelle. Das kostet Zeit und Geld. Zeit und Geld, die stattdessen in Produktentwicklung fließen könnten.

Der Haken für den Finanzstandort Deutschland: Während hiesige FinTechs sich durch Bürokratie kämpfen, bauen Wettbewerber aus dem Vereinigten Königreich, aus Singapur oder aus den USA ihre Agentic-AI-Plattformen schneller aus – und greifen dann mit gut entwickelten Produkten auf den europäischen Markt zu. Ohne Passport, mit deutlich weniger regulatorischem Reibungsverlust in der Entwicklungsphase.

Rechnen wir nach, was wir wissen: Agentic AI im Banking ist real, messbar wirksam in Fraud-Detection und Onboarding, und im Trading noch im Pilotstadium. Die Zahlen – 80 bis 90 Prozent unstrukturierte Daten, 60 Prozent Effizienzraten bei traditionellen Banken, 77 Prozent der Verbraucher, die KI in der Fraud-Prevention wollen – zeigen, warum das Interesse so groß ist. Der Markt ist bereit. Die Technologie ist reif genug für erste skalierbare Einsätze.

Was bleibt, ist die entscheidende Frage, die autonome Trading-Systeme und Deep-Tech-Banking aufwerfen: Wer trägt die Verantwortung, wenn ein KI-Agent falsch entscheidet? Die Antwort darauf – rechtlich, ethisch, unternehmerisch – wird darüber entscheiden, wie schnell und wie sicher Agentic AI in den Kern des Bankbetriebs einzieht. Bis diese Frage beantwortet ist, brauchen autonome Systeme immer einen menschlichen Ankerpunkt – nicht weil die Technologie es erfordert, sondern weil Vertrauen es erfordert.

Und vertrauen Sie mir: Vertrauen ist die einzige Währung im Banking, die keine KI drucken kann. Wie sieht Ihre Bank das?

Um Ihnen ein optimales Erlebnis zu bieten, verwenden wir Technologien wie Cookies, um Geräteinformationen zu speichern und/oder darauf zuzugreifen. Wenn Sie diesen Technologien zustimmen, können wir Daten wie Ihr Surfverhalten oder eindeutige IDs auf dieser Website verarbeiten. Wenn Sie Ihre Zustimmung nicht erteilen oder widerrufen, können bestimmte Merkmale und Funktionen beeinträchtigt werden.